La secuencia de un presunto sicario mexicano recomendando a jóvenes estudiar se creó con IA

- Publicado el 27 de febrero de 2026 a las 21:45

- 4 minutos de lectura

- Por Lucero MENDEZ, AFP México

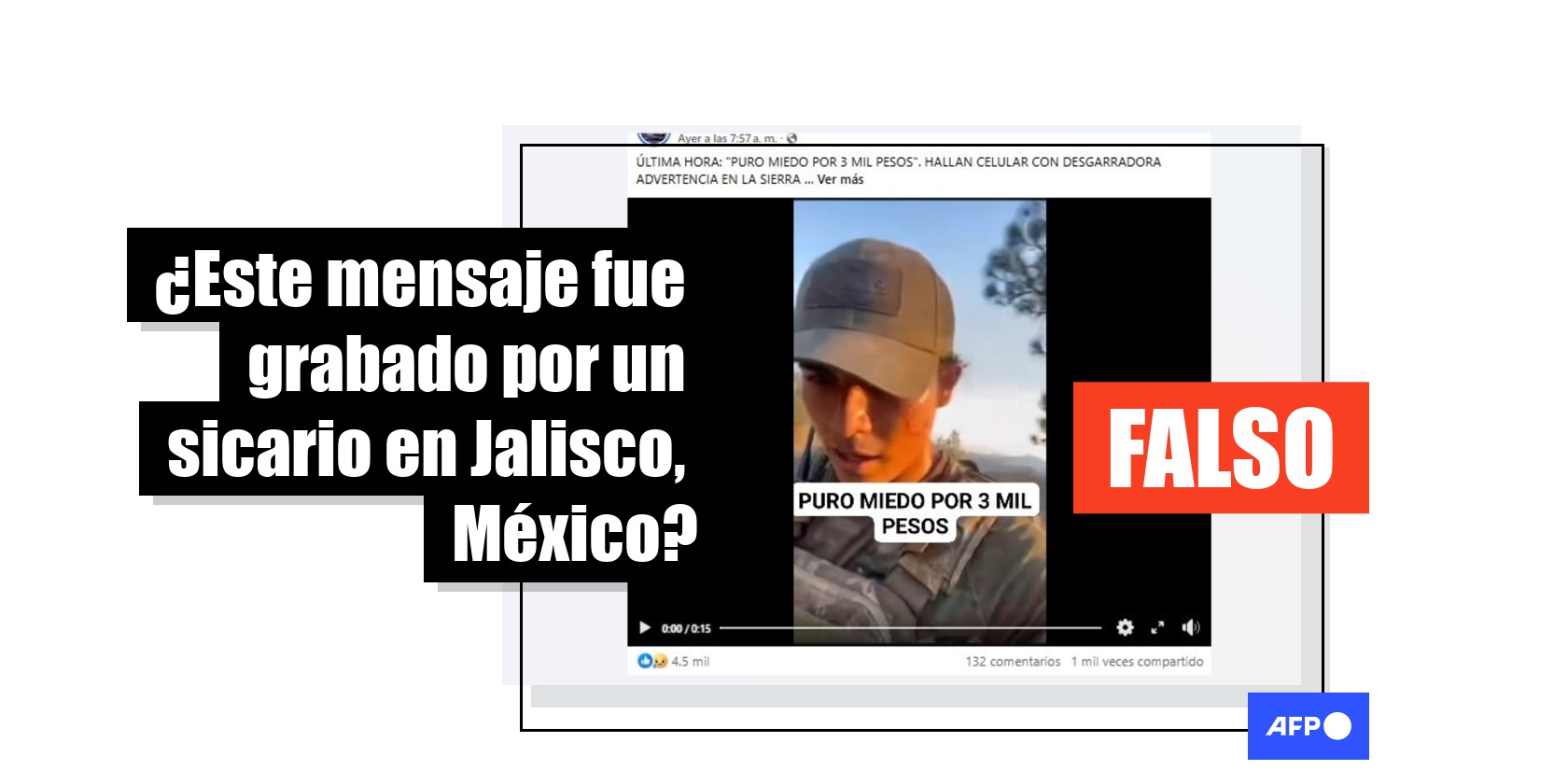

El gobierno mexicano desplegó a más de 10.000 militares para controlar la ola de violencia que provocó la muerte del narcotraficante Nemesio Oseguera, alias “El Mencho”, en un operativo el 22 de febrero de 2026. Días después, el video de un muchacho que aconseja a los jóvenes a estudiar y a no creer en los mitos sobre el crimen organizado se compartió más de 20.000 veces en redes sociales, junto a la afirmación de que fue hallado en un celular en la sierra de Jalisco (oeste). Pero la secuencia fue generada con inteligencia artificial (IA).

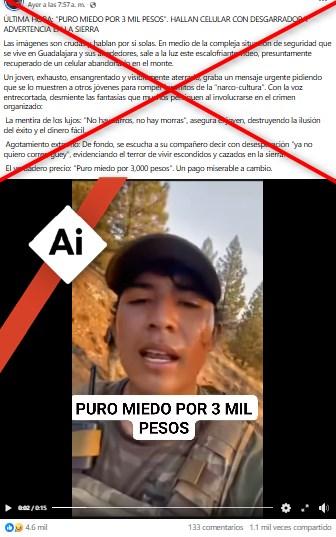

“ÚLTIMA HORA: ‘Puro miedo por 3 mil pesos’. Hallan celular con desgarradora advertencia en la sierra. Las imágenes son crudas y hablan por sí solas. En medio de la compleja situación que se vive en Guadalajara y sus alrededores, sale a la luz este escalofriante video”, señalan publicaciones en Facebook (1, 2), que incluyen un video de 15 segundos en el que un joven que está en un monte dice: “Mándale este video a tu hijo, carnal. Neta no te alucines, aquí andaba yo hoy. Mira cómo ando: No hay carros, no hay morras, puro miedo por 3.000 pesos, mejor estudia”.

Algunas entradas afirman que el joven del video es un sicario que murió. La secuencia también se ha compartido en X, YouTube, Instagram y TikTok. Incluso medios de comunicación la replicaron.

Bloqueos de carreteras, quema de vehículos y enfrentamientos con militares en varias regiones de México fueron algunas de las secuelas que dejó la muerte de “El Mencho”, líder del Cártel Jalisco Nueva Generación (CJNG), tras un operativo militar en la localidad de Tapalpa, Jalisco.

Guadalajara y Puerto Vallarta, ambos ubicados en Jalisco, fueron las zonas que más resintieron la ola de violencia, que, de acuerdo con expertos, podría reavivarse en la búsqueda de un nuevo liderazgo al interior de ese cártel.

Contenido generado con IA

Una revisión del video viral permitió identificar irregularidades en la secuencia propias de contenido generado con IA. Por ejemplo: el paisaje del fondo con definición borrosa; el rostro del hombre que camina es borroso y por un momento se distorsiona; los ojos del joven nunca se aprecian pese a estar en un lugar iluminado y la antena de su radio portátil se distorsiona.

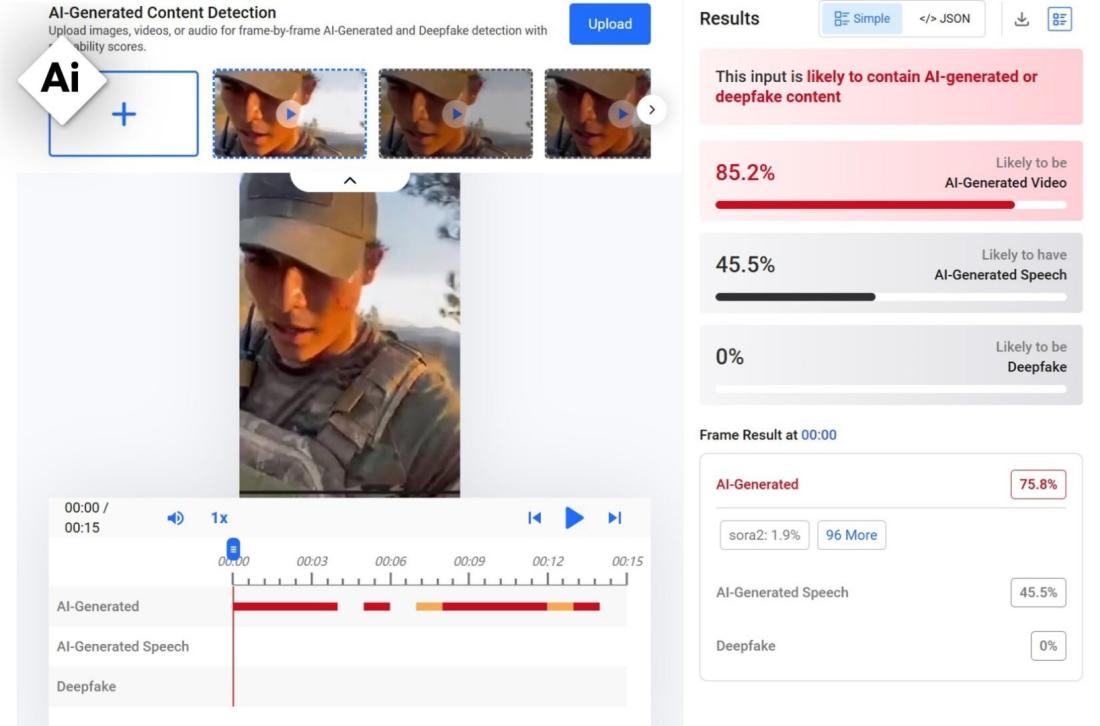

Un análisis de la secuencia con la herramienta Hive Moderation arrojó un 85,2% de probabilidades de que la imagen y su audio fueran creados con IA.

Otro análisis del audio con la herramienta Hiya de InVID-WeVerify, que examina audios sintéticos, arrojó una posibilidad de 99%.

Marco Benalcázar, director del Laboratorio de Investigación en Inteligencia y Visión Artificial “Alan Turing” de la Escuela Politécnica Nacional de Quito, explicó a AFP Factual que el material muestra “signos de haber sido creado en su totalidad o al menos alterado por IA”.

Explicó el 26 de febrero que es complicado determinar qué tanto del contenido se generó o alteró con IA, pero que sí es posible identificar alteraciones:

“Observando la boca de la persona, en determinados momentos los dientes superiores e inferiores parecen formar un solo bloque y no la separación que normalmente se tiene en un video real. Esa es una señal visible de que el video no es auténtico”.

Destacó que otra señal para analizar con mayor detalle es que los ojos del joven no cambian, lucen como una mancha negra constante: “Normalmente cuando una persona gira su cabeza en alguna parte se pueden ver las pupilas, sobre todo porque estas tienden a reflejar la luz”.

Contenidos similares

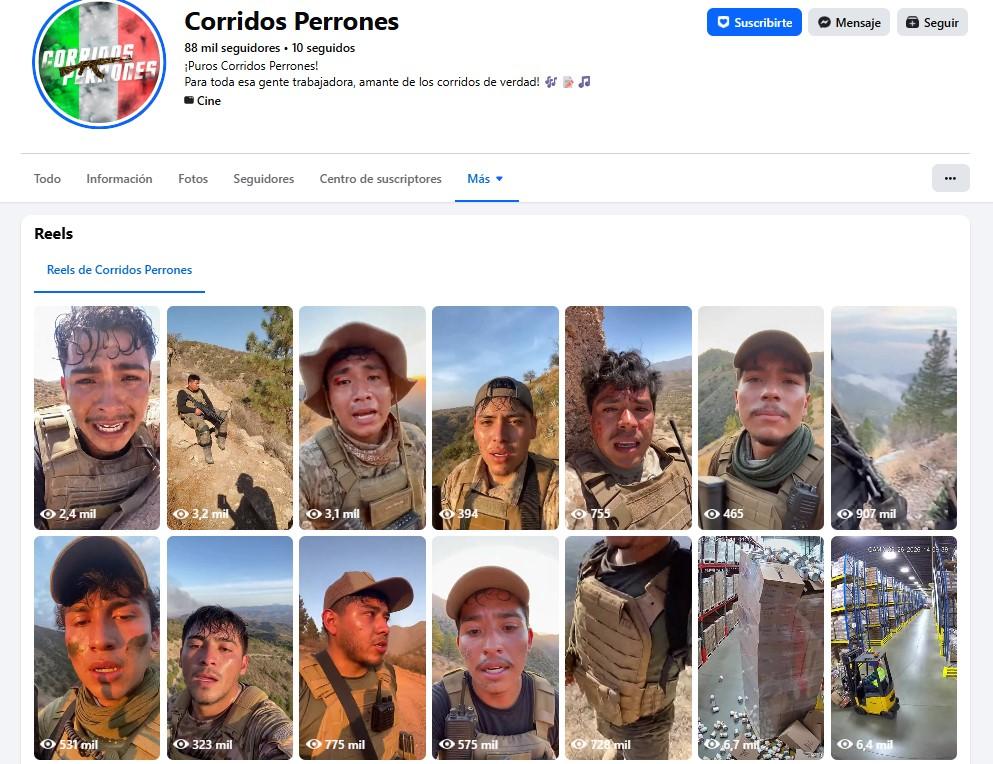

Búsquedas inversas con fotogramas del video en Google condujeron a una publicación en Facebook el 25 de febrero a las 07H11 que muestra la misma secuencia. No se encontraron registros más antiguos a esa fecha y hora.

Tras una revisión de esa cuenta en Facebook llamada “Corridos Perrones”, se identificó que desde el 22 de febrero publicó varias secuencias similares al video viral en las que jóvenes dicen lo mismo: “No hay lujos, no hay carros del año, no hay morras, mejor estudien y échenle ganas”.

La AFP analizó tres de esos videos (1, 2, 3) con la herramienta de detección de IA Hive Moderation, que arrojó valores superiores al 99%.

En los últimos meses, el equipo de AFP Factual ha identificado (1, 2, 3) una tendencia en los contenidos generados con IA que muestra a supuestas personas grabándose en formato vertical en secuencias que duran 15 segundos. Ese es el lapso máximo permitido por plataformas como Sora, una aplicación móvil de OpenAI mediante la que se pueden crear videos con IA a partir de prompts (indicaciones textuales).

AFP Factual ha verificado otros contenidos generados con IA que puedes consultar aquí.

Referencias

Copyright © AFP 2017-2025. Cualquier uso comercial de este contenido requiere una suscripción. Haga clic aquí para obtener más información.

¿Duda sobre la veracidad de una información, una foto o un video?

Contáctenos